Dans cet article, nous définissons clairement l’algorithme et vous guidons pas à pas pour en maîtriser les concepts essentiels, des représentations (pseudocode, organigrammes, diagrammes d’activité) aux quatre propriétés fondamentales (entrée, sortie, finitude, déterminisme). Vous découvrirez comment évaluer l’efficacité d’une méthode — complexité temporelle et spatiale, notation Big O — puis les principales techniques de conception (diviser pour régner, programmation dynamique, glouton, backtracking, récursion) illustrées par des exemples concrets comme les tris, les recherches et l’algorithme d’Euclide. La suite propose des mises en œuvre en pseudocode, Python et JavaScript pour passer de la théorie à la pratique, des conseils d’optimisation et des outils d’analyse de performance. Enfin, des cas d’usage réels (routage, cryptographie, machine learning) montrent comment ces procédés s’appliquent dans des projets concrets. Ton pédagogique, explications claires et exemples pas‑à‑pas vous accompagneront pour rendre ces notions accessibles aux débutants comme aux développeurs souhaitant consolider leurs bases.

Fondamentaux des algorithmes

**Définition claire et accessible d’un algorithme**

Un algorithme constitue une suite finie d’instructions précises permettant de résoudre un problème ou d’accomplir une tâche spécifique. C’est un guide pas à pas qui transforme des données d’entrée en résultats attendus. Par exemple, une recette de cuisine est un algorithme : elle liste les ingrédients (entrées) et les étapes à suivre pour obtenir un plat (sortie). En informatique, un algorithme peut recommander des livres selon vos achats précédents ou piloter une voiture autonome. L’algorithmique, discipline qui étudie ces méthodes, définit les règles et techniques pour concevoir des algorithmes efficaces. Contrairement à un programme informatique, un algorithme reste indépendant du langage : il décrit la logique avant sa traduction en code Python, JavaScript ou autre langage de programmation.

**Caractéristiques essentielles (entrée, sortie, finitude, déterminisme)**

Comprendre ce qu’est un algorithme et sa définition nécessite de connaître ses quatre piliers fondamentaux. L’entrée représente les données initiales fournies : dans un algorithme calculant la somme de deux nombres, les entrées sont a = 5 et b = 3. La sortie correspond au résultat produit : ici, 8. La finitude garantit que l’algorithme se termine toujours. L’algorithme d’Euclide pour calculer le PGCD de 48 et 18 s’arrête en 3 étapes lorsque le reste devient zéro. Le déterminisme assure qu’une même entrée produit toujours la même sortie. Un tri par insertion transforme 3, 1, 4, 1 en 1, 1, 3, 4 à chaque exécution, sans variation. Ces propriétés distinguent un algorithme correct d’une procédure imprécise et s’appliquent autant aux algorithmes mathématiques qu’aux exemples d’algorithmes informatiques.

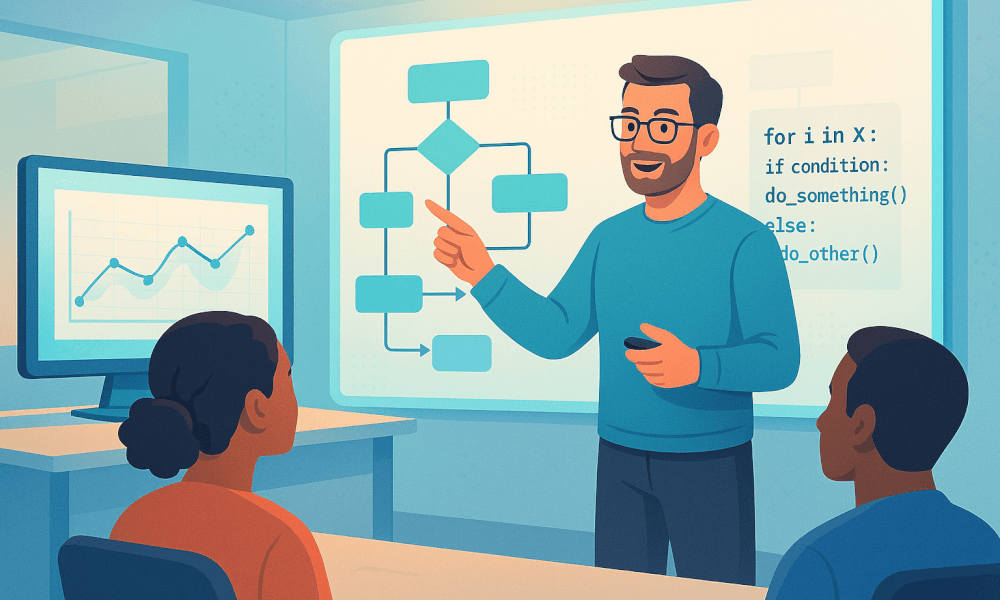

**Représentations : pseudocode, organigrammes (flowcharts) et diagrammes d’activité**

Pour faciliter la compréhension, il est utile de choisir une représentation graphique ou textuelle. Les trois approches principales sont les suivantes :

- **Pseudocode (pseudo-code)** : description textuelle structurée en trois parties (en-tête, déclarations, corps). Idéal pour les algorithmes complexes grâce à sa lisibilité et sa flexibilité. Exemple : « Tant que nombre ≠ 0, Afficher 2 × nombre ». Modifiable aisément mais moins visuel. Cette notation reste indépendante du langage de programmation.

- **Organigramme (logigramme ou diagramme de flux)** : représentation graphique utilisant des symboles normalisés. Les ovales marquent début/fin, les rectangles les traitements, les losanges les décisions. Offre une vision rapide du processus et facilite l’analyse algorithmique. Limite : inadapté aux longs algorithmes car chaque traitement complexe exige de multiples symboles élémentaires.

- **Diagramme d’activité** : outil UML avec rectangles aux coins arrondis pour chaque action. Vision proche des langages de programmation, parfait pour les processus métier et l’implémentation d’algorithme. Requiert toutefois la maîtrise de la notation UML standardisée.

Avant de découvrir les différences, voici un comparatif sous forme de tableau des différentes représentations :

| **Critère** | **Pseudocode** | **Organigramme** | **Diagramme d’activité** |

|---|---|---|---|

| **Nature** | Textuelle | Graphique | Graphique UML |

| **Lisibilité** | Excellente pour algorithmes longs | Vision rapide | Proche du code |

| **Flexibilité** | Haute | Limitée | Moyenne |

| **Symboles requis** | Aucun | Normalisés obligatoires | UML standardisés |

Commencer par un organigramme avant de formaliser en pseudocode reste une pratique recommandée pour structurer la réflexion et faciliter l’implémentation ultérieure en Python ou autre langage.

Comment analyser la performance d’un algorithme ?

**Notions de base d’analyse : complexité temporelle et spatiale, notation Big O avec exemples simples**

Après avoir compris la définition d’un algorithme informatique, il est important d’évaluer son efficacité. La complexité algorithmique repose sur deux critères essentiels : la complexité temporelle, qui mesure le nombre d’opérations selon la taille d’entrée n, et la complexité spatiale, qui quantifie l’utilisation de la mémoire. L’analyse algorithmique utilise la notation Big O pour exprimer cette croissance : O(1) signifie constant, O(n) linéaire, O(n²) quadratique, et O(log n) logarithmique.

Pour illustrer ces concepts, prenons des exemples concrets. Pour un algorithme de recherche linéaire : avec n = 100 éléments, il effectue au pire 100 opérations (O(n)). La recherche binaire sur une liste triée ne nécessite que 7 opérations environ (O(log n)), démontrant l’importance de l’optimisation de code.

Concernant les algorithmes de tri, le tri par insertion avec n = 100 éléments compte environ 5 000 comparaisons (O(n²)), contre seulement 664 pour le tri fusion ou Merge Sort (O(n log n)), et des performances similaires pour le tri rapide QuickSort en moyenne. Ce compromis temps-espace guide le choix lors de l’implémentation d’un algorithme : le tri par insertion consomme O(1) en mémoire, tandis que le tri fusion nécessite O(n). Cette analyse de la complexité temporelle et spatiale permet de sélectionner l’algorithme optimal selon les contraintes du projet.

Quelles sont les techniques de conception d’algorithmes ?

**Techniques de conception : diviser pour régner, programmation dynamique, glouton, backtracking, récursion**

Une fois la performance d’un algorithme analysée, il devient essentiel de maîtriser différentes méthodes pour concevoir de nouveaux algorithmes efficaces. Cinq techniques dominent l’algorithmique et la conception d’algorithmes. Pour mieux comprendre leurs spécificités et applications, le tableau comparatif suivant est présenté :

| **Technique** | **Principe** | **Complexité temporelle** | **Exemple concret** | **Cas d’usage** |

|---|---|---|---|---|

| Diviser pour régner | Divise le problème en sous-problèmes, résout récursivement, puis recombine les solutions | O(n log n) | Tri par fusion (Merge Sort) | Tri de grands ensembles de données en bases de données |

| Programmation dynamique | Décompose en sous-problèmes chevauchants, stocke les solutions pour éviter les recalculs | O(n²) ou O(nk) | Plus longue sous-séquence commune (LCS) | Comparaison de séquences ADN en bioinformatique |

| Algorithme glouton | Choisit l’option localement optimale à chaque étape sans anticiper les conséquences | O(n log n) | Sélection d’activités | Ordonnancement de réunions ou tâches |

| Backtracking | Explore toutes les solutions candidates, abandonne une branche dès qu’elle échoue | O(k^n) exponentielle | Problème des N-Reines | Résolution de Sudoku ou puzzles de placement |

| Récursion | Une fonction s’appelle elle-même sur des instances réduites jusqu’à un cas de base | Variable (O(2^n) sans optimisation) | Calcul de factorielle | Parcours d’arbres ou génération de fractales |

Chaque approche algorithmique répond à des besoins distincts en programmation et en informatique. La programmation dynamique excelle pour l’optimisation combinatoire et les calculs répétitifs, tandis que le backtracking convient aux problèmes nécessitant une exploration exhaustive. L’algorithme de tri rapide (QuickSort) et le tri fusion (Merge Sort) illustrent la puissance de l’approche diviser pour régner. La maîtrise de la récursivité, ainsi que le choix entre itératif et récursif, permet d’optimiser la performance algorithmique selon le contexte d’application.

Algorithmes classiques en informatique

Après avoir exploré les techniques de conception, passons aux algorithmes fondamentaux que tout débutant doit maîtriser. Les algorithmes de tri (https://example.com) et les algorithmes de recherche (https://example.com) constituent la base de l’informatique pratique et de la programmation. Comprendre ces exemples permet de saisir la complexité algorithmique et d’améliorer la performance de vos programmes.

**Étape 1 : Le tri à bulles (Bubble Sort)**

Commencez par parcourir le tableau 5, 2, 4, 7, 1, 3. Comparez chaque paire d’éléments adjacents. Si l’élément de gauche dépasse celui de droite, échangez-les. Lors de la première passe, 5 et 2 s’inversent, donnant 2, 4, 5, 1, 3, 7. Le 7 « bulle » vers la fin. Répétez jusqu’à ce qu’aucun échange ne survienne. Sur 1000 éléments aléatoires, attendez-vous à environ 500 000 comparaisons et 950 ms d’exécution. Sur 5000 éléments en ordre décroissant (pire cas), le temps explose à 24 000 ms avec 12 millions de comparaisons. Cet algorithme de tri simple illustre parfaitement la complexité temporelle en O(n²).

**Étape 2 : Le tri par insertion (Insertion Sort)**

Démarrez avec le deuxième élément comme clé. Prenez 5, 2, 4, 7, 1, 3 : la clé 2 (i=1) se décale à gauche car 5 > 2, résultant en 2, 5, 4, 7, 1, 3. Continuez avec 4 (i=2) qui glisse entre 2 et 5. Le 1 (i=4) traverse tout le tableau. Cette méthode brille sur des données presque triées : 5000 éléments quasi ordonnés ne nécessitent que 1200 ms et 12 000 décalages, contre 450 ms pour 1000 éléments aléatoires. L’insertion bat souvent le tri à bulles sur petits tableaux. En Python, cet algorithme s’implémente facilement et démontre une excellente complexité spatiale en O(1).

**Étape 3 : Le tri fusion (Merge Sort)**

Divisez récursivement le tableau 5, 2, 4, 7, 1, 3, 2, 6 en sous-tableaux individuels. Fusionnez 5 et 2 en 2, 5, puis 4 et 7 en 4, 7. Combinez ces paires pour obtenir 2, 4, 5, 7. Répétez pour l’autre moitié, obtenant 1, 2, 3, 6. La fusion finale produit 1, 2, 2, 3, 4, 5, 6, 7. Avec 50 000 éléments aléatoires, ce tri s’exécute en 150 ms avec seulement 16 appels de fusion, démontrant sa complexité O(n log n) selon la notation Big O. Il consomme O(n) mémoire supplémentaire, un compromis pour sa rapidité constante. Cette approche itérative versus récursive illustre la puissance de la programmation dynamique et est un excellent exemple d’algorithme en programmation moderne.

**Étape 4 : La recherche linéaire**

Parcourez séquentiellement chaque élément du tableau non trié 1, 3, 5, 7 pour trouver 5. Comparez successivement : 1 ≠ 5, 3 ≠ 5, 5 = 5. Trouvé à l’index 2 après 3 comparaisons. Sur 1000 éléments, une cible en fin de liste impose 1000 comparaisons et 1000 µs. La position moyenne exige 500 comparaisons. Simple mais inefficace sur de grandes quantités de données, cette approche ne requiert aucun pré-tri. Comprendre sa définition et son implémentation permet de mieux appréhender l’analyse algorithmique.

**Étape 5 : La recherche binaire**

Triez d’abord le tableau. Sur 1, 2, 3, 4, 5, 6, 7 cherchant 5, calculez mid = (0 + 6)/2 = 3. L’élément T[3] = 4 est inférieur à 5, donc éliminez la moitié gauche. Nouveau mid = (4 + 6)/2 = 5. T[5] = 6 est supérieur à 5, ajustez à droite. T[4] = 5 : trouvé en 3 étapes au lieu de 5. Avec 1 million d’éléments, seulement 20 étapes maximum (log₂ 1 000 000 ≈ 20) contre 1 million en linéaire. L’implémentation itérative consomme O(1) mémoire. Le pré-tri représente un coût initial, mais les recherches répétées deviennent fulgurantes. Cet algorithme déterministe constitue un exemple d’algorithme fondamental, applicable tant en mathématique qu’en programmation, et s’intègre parfaitement dans un cours d’algorithme et programmation en PDF.

Algorithmes mathématiques fondamentaux

Après avoir exploré les algorithmes classiques en informatique, penchons-nous sur ceux qui ont façonné la discipline. L’algorithme d’Euclide constitue une méthode ancestrale pour calculer le PGCD de deux nombres, un exemple d’algorithme particulièrement élégant en algorithmique. Prenons 48 et 18 : on divise 48 par 18, reste 12. Puis 18 par 12, reste 6. Enfin 12 par 6, reste 0. Le PGCD est 6. Le nombre d’itérations ne dépasse jamais 2,0781 × ln(b) + 1 selon le théorème de Lamé. La complexité temporelle globale atteint O(ℓ²) où ℓ représente la taille binaire des nombres, illustrant l’importance de l’analyse de la complexité algorithmique.

Le crible d’Ératosthène identifie tous les nombres premiers jusqu’à n grâce à une approche itérative efficace. On marque les multiples de chaque premier à partir de p². Pour n = 30, après avoir barré les multiples de 2, 3 et 5, subsistent : 2, 3, 5, 7, 11, 13, 17, 19, 23, 29. La complexité temporelle s’établit à O(n log log n), une performance remarquable en notation Big O. L’algorithme binaire de PGCD évite les divisions coûteuses en exploitant les shifts binaires, optimisant ainsi la performance algorithmique. L’algorithme d’Euclide étendu, quant à lui, calcule en plus les coefficients de Bézout : pour PGCD(48,18) = 6, on obtient 6 = 2×48 + (-5)×18. Ces exemples montrent comment l’algorithme et la programmation se rejoignent dans la résolution de problèmes mathématiques fondamentaux.

Comment implémenter un algorithme en pratique ?

**Implémentations types en pseudocode puis en Python et/ou JavaScript pour débutants**

Après avoir découvert les algorithmes classiques, il est temps de passer à leur mise en œuvre concrète. On débute par une approche en pseudo-code pour un algorithme de combinaisons, technique courante en optimisation combinatoire. La structure reste simple : on définit une fonction qui prend deux paramètres n et k, puis on crée un tableau vide pour stocker les résultats. Si k égale 1, on retourne directement n. Sinon, on parcourt chaque élément, on sépare la tête (premier élément) du reste, puis on applique la récursivité sur la queue avant de concaténer les résultats. Cette approche récursive illustre bien la différence entre un algorithme itératif et un algorithme récursif.

**Étape 1 : Traduire le pseudocode en Python**

Créez une fonction combinations(n, k) qui initialise une liste vide combos = []. Utilisez n[i:i+1] pour extraire le premier élément et combinations(n[i+1:], k-1) pour l’appel récursif. Cette approche divise le problème en sous-problèmes plus petits grâce à la programmation dynamique. Par exemple, combinations(1, 2, 3, 4, 2) retourne [[1, 2], [1, 3], [1, 4], [2, 3], [2, 4], [3, 4]]. Python facilite l’implémentation grâce à sa syntaxe claire, ce qui en fait un langage idéal pour comprendre l’algorithmique et tester des exemples.

**Étape 2 : Adapter l’implémentation en JavaScript**

Transposez la logique Python en JavaScript avec const combinations = (n, k) => {}. Remplacez les slices Python par n.slice(i, i + 1) pour la tête et n.slice(i + 1) pour le reste. Utilisez concat() au lieu de l’opérateur + pour fusionner les tableaux. Le résultat reste identique. La complexité temporelle atteint O(n! / (k! × (n-k)!)) car l’algorithme génère toutes les combinaisons possibles par récursion. Cette complexité peut être analysée avec la notation Big O pour évaluer la performance et l’optimisation de code nécessaire selon les besoins de votre application.

Applications concrètes des algorithmes

**Cas d’usage et applications réelles (tri, recherche, routage, cryptographie, machine learning)**

Pour conclure, découvrons comment les algorithmes se traduisent en applications concrètes dans notre quotidien numérique. Le tri rapide (QuickSort) et le tri fusion (Merge Sort), bien qu’invisibles, optimisent les réseaux IoT et l’optimisation combinatoire : l’algorithme quantique inspiré QIC trie des solutions de clustering en moins de 5 minutes pour 100 nœuds avec une complexité algorithmique optimale, économisant **15,48 %** d’énergie, tandis que QIPSOC atteint des réductions énergétiques allant jusqu’à **91 %**. La recherche de données repose sur des algorithmes tels que la recherche binaire et A*, ce dernier adapté au routage en temps réel grâce à son approche heuristique, ou encore Naive Bayes dans les réseaux SDN, réduisant délais et charge de signalisation pour le transport intelligent urbain testé sur données de Montréal. En routage, l’algorithme de Dijkstra et l’algorithme de Bellman-Ford permettent une localisation précise des nœuds avec des performances remarquables en complexité temporelle. La cryptographie bénéficie du machine learning : le gradient boosting excelle dans la prédiction d’attaques V2G sur véhicules électriques, tandis que TensorFlow et Keras déploient des systèmes de détection d’intrusions en temps réel sur CPU, GPU ou TPU, combinant algorithme de chiffrement et intelligence artificielle pour renforcer la sécurité informatique. Ces exemples illustrent parfaitement la performance algorithmique moderne dans divers domaines.

Pour récapituler, l’algorithme étudié ici repose sur des piliers simples — entrée, sortie, finitude et déterminisme — et se formalise efficacement grâce au pseudocode, aux organigrammes ou aux diagrammes d’activité. Retenez les notions clés d’analyse (complexité temporelle et spatiale, notation Big O), les techniques de conception incontournables (diviser pour régner, programmation dynamique, glouton, backtracking, récursivité) ainsi que les exemples pratiques (tris, recherches, PGCD, crible d’Ératosthène) qui illustrent chaque principe. À titre pratique, commencez toujours par schématiser le procédé, rédigez un pseudo-code clair, implémentez en Python ou JavaScript, puis profilez et comparez les performances pour choisir la meilleure méthode selon vos contraintes temps/mémoire. En vous exerçant sur des petits projets et des exercices pas-à-pas, vous transformerez ces concepts en savoir-faire opérationnel et saurez adapter vos procédures et techniques aux problèmes réels.